Teknologi yang boleh menghasilkan deepfakes tersedia secara meluas. (Shutterstock)

Pada awal Mac, a video dimanipulasi Presiden Ukraine Volodymyr Zelenskyy telah disebarkan. Di dalamnya, Zelenskyy yang dijana secara digital memberitahu tentera negara Ukraine untuk menyerah diri. Video itu diedarkan dalam talian tetapi dengan cepat disangkal sebagai deepfake — video hiper-realistik lagi palsu dan dimanipulasi yang dihasilkan menggunakan kecerdasan buatan.

Walaupun maklumat salah Rusia nampaknya mempunyai kesan terhad, contoh yang membimbangkan ini menggambarkan kemungkinan akibat daripada deepfakes.

Walau bagaimanapun, deepfakes digunakan dengan jayanya dalam teknologi bantuan. Sebagai contoh, orang yang menghidap penyakit Parkinson boleh menggunakan pengklonan suara untuk berkomunikasi.

Deepfakes digunakan dalam pendidikan: Syarikat sintesis pertuturan yang berpangkalan di Ireland CereProc mencipta suara sintetik untuk John F. Kennedy, menghidupkannya kembali untuk menyampaikan ucapan sejarahnya.

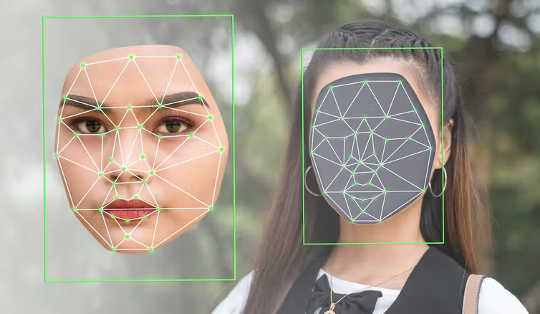

Namun setiap syiling mempunyai dua sisi. Deepfakes boleh menjadi hiper-realistik, dan pada dasarnya tidak dapat dikesan oleh mata manusia.

Oleh itu, teknologi pengklonan suara yang sama boleh digunakan untuk pancingan data, fitnah dan pemerasan. Apabila deepfakes sengaja digunakan untuk membentuk semula pendapat umum, menghasut konflik sosial dan memanipulasi pilihan raya, ia berpotensi untuk menjejaskan demokrasi.

Penyelidik di Universiti Washington menghasilkan palsu Barack Obama.

Menyebabkan huru-hara

Deepfakes adalah berdasarkan teknologi yang dikenali sebagai rangkaian adversarial generatif di mana dua algoritma melatih satu sama lain untuk menghasilkan imej.

Walaupun teknologi di sebalik pemalsuan mendalam mungkin kedengaran rumit, ia adalah perkara yang mudah untuk menghasilkan satu. Terdapat banyak aplikasi dalam talian seperti Tukar muka and ZAO Deepswap yang boleh menghasilkan deepfakes dalam beberapa minit.

Google Colaboratory — repositori dalam talian untuk kod dalam beberapa bahasa pengaturcaraan — termasuk contoh kod itu boleh digunakan untuk menjana imej dan video palsu. Dengan perisian yang boleh diakses ini, adalah mudah untuk melihat bagaimana pengguna biasa boleh mendatangkan malapetaka dengan deepfakes tanpa menyedari potensi risiko keselamatan.

Populariti apl tukar muka dan perkhidmatan dalam talian seperti Nostalgia yang mendalam menunjukkan betapa cepat dan meluas deepfakes boleh diterima pakai oleh orang awam. Pada tahun 2019, kira-kira 15,000 video menggunakan deepfakes telah dikesan. Dan jumlah ini dijangka meningkat.

Deepfakes ialah alat yang sesuai untuk kempen disinformasi kerana ia menghasilkan berita palsu yang boleh dipercayai yang memerlukan masa untuk membongkar. Sementara itu, kerosakan yang disebabkan oleh deepfakes — terutamanya yang menjejaskan reputasi orang ramai — selalunya tahan lama dan tidak dapat dipulihkan.

DeepSwap ialah pilihan yang bagus untuk sesiapa sahaja yang ingin mencipta deepfakes yang meyakinkan dengan usaha yang minimum. ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #Tukar Muka #DeepFake #FaceApp #Reface #Semakan #Ulasan #Kecerdasan Buatan #AI #tech #Teknologi #TechNews #TechnologyNews #MENA #TechMGZNhttps://t.co/A2Cbp02sH1

— Majalah Tech (@TechMGZN) Semoga 4, 2022

Adakah melihat percaya?

Mungkin akibat yang paling berbahaya dari deepfake ialah bagaimana mereka meminjamkan diri mereka kepada maklumat yang salah dalam kempen politik.

Kami melihat ini apabila Donald Trump menetapkan sebarang liputan media yang tidak menarik sebagai “berita palsu.” Dengan menuduh pengkritiknya menyebarkan berita palsu, Trump dapat menggunakan maklumat yang salah untuk mempertahankan kesalahannya dan sebagai alat propaganda.

Strategi Trump membolehkannya mengekalkan sokongan dalam persekitaran yang penuh dengan ketidakpercayaan dan ketidakpercayaan dengan mendakwa “bahawa peristiwa dan cerita benar adalah berita palsu atau palsu"

Kredibiliti dalam pihak berkuasa dan media semakin terjejas, mewujudkan iklim ketidakpercayaan. Dan dengan peningkatan penyebaran deepfake, ahli politik dengan mudah boleh menafikan kesalahan dalam mana-mana skandal yang muncul. Bagaimanakah identiti seseorang dalam video boleh disahkan jika mereka menafikannya?

Memerangi maklumat yang salah, bagaimanapun, sentiasa menjadi cabaran bagi negara demokrasi ketika mereka cuba menegakkan kebebasan bersuara. Perkongsian Human-AI boleh membantu menangani peningkatan risiko deepfakes dengan meminta orang ramai mengesahkan maklumat. Memperkenalkan perundangan baharu atau menggunakan undang-undang sedia ada untuk menghukum pengeluar deepfake kerana memalsukan maklumat dan menyamar sebagai orang juga boleh dipertimbangkan.

Pendekatan pelbagai disiplin oleh kerajaan antarabangsa dan negara, syarikat swasta dan organisasi lain semuanya penting untuk melindungi masyarakat demokratik daripada maklumat palsu.![]()

Tentang Pengarang

Sze-Fung Lee, Pembantu Penyelidik, Jabatan Pengajian Maklumat, McGill University and Benjamin CM Fung, Profesor dan Pengerusi Penyelidikan Kanada dalam Perlombongan Data untuk Keselamatan Siber, McGill University

Artikel ini diterbitkan semula daripada Perbualan di bawah lesen Creative Commons. Membaca artikel asal.