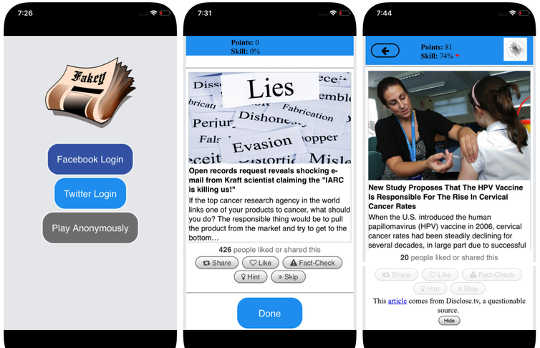

Tangkapan skrin permainan Fakey. Mihai Avram dan Filippo Menczer

Tangkapan skrin permainan Fakey. Mihai Avram dan Filippo Menczer

Media sosial adalah antara sumber utama berita di Amerika Syarikat dan seluruh dunia. Namun pengguna terdedah kepada kandungan ketepatan yang dipersoalkan, termasuk teori-teori konspirasi, Clickbait, kandungan hyperpartisan, sains pseudo dan malah laporan palsu "berita palsu".

Tidak menghairankan bahawa terdapat begitu banyak maklumat yang disiarkan: Spam dan penipuan dalam talian adalah lumayan untuk penjenayah, dan hasil propaganda kerajaan dan politik kedua-dua faedah partisan dan kewangan. Tetapi hakikat itu kandungan kredibiliti rendah merebak dengan cepat dan mudah mencadangkan bahawa orang dan algoritma di sebalik platform media sosial terdedah kepada manipulasi.

Penyelidikan kami telah mengenalpasti tiga jenis kecenderungan yang menjadikan ekosistem media sosial terdedah kepada maklumat palsu yang salah dan tidak disengajakan. Itulah sebabnya kami Balai Cerap di Media Sosial di Universiti Indiana sedang dibina alat untuk membantu orang menyedari sikap berat sebelah ini dan melindungi diri mereka dari pengaruh luar yang direka untuk mengeksploitasi mereka.

Menjelaskan alat yang dibangunkan di Observatorium Media Sosial:

{youtube}https://youtu.be/BIv9054dBBI{/youtube}

Bias di dalam otak

Bias kognitif berasal dari cara otak memproses maklumat yang dihadapi setiap orang setiap hari. Otak boleh menangani hanya sejumlah maklumat yang terbatas, dan terlalu banyak rangsangan masuk yang boleh menyebabkan maklumat yang berlebihan. Itu sendiri mempunyai implikasi yang serius untuk kualiti maklumat di media sosial. Kami telah mendapati bahawa persaingan yang curam untuk perhatian terhad pengguna bermakna bahawa beberapa idea menjadi virus walaupun kualitinya rendah - walaupun orang lebih suka berkongsi kandungan berkualiti tinggi.

Untuk mengelakkan terharu, otak menggunakan a bilangan helah. Kaedah ini biasanya berkesan, tetapi juga boleh menjadi berat sebelah apabila digunakan dalam konteks yang salah.

Satu pintasan kognitif berlaku apabila seseorang memutuskan sama ada untuk berkongsi cerita yang muncul di suapan media sosial mereka. Manusia adalah sangat terjejas oleh konotasi emosi tajuk utama, walaupun itu bukan penunjuk yang baik tentang ketepatan artikel. Lebih penting lagi yang menulis surat itu.

Untuk mengatasi kecenderungan ini, dan membantu orang memberi perhatian lebih kepada sumber tuntutan sebelum berkongsi, kami maju Fakey, sebuah permainan literasi berita mudah alih (percuma pada Android and iOS) menyerupai suapan berita media sosial tipikal, dengan campuran artikel berita dari sumber arus perdana dan kredibiliti rendah. Pemain mendapat lebih banyak mata untuk berkongsi berita dari sumber yang boleh dipercayai dan menandakan kandungan mencurigakan untuk pemeriksaan fakta. Dalam proses ini, mereka belajar untuk mengenal pasti isyarat kredibiliti sumber, seperti tuntutan hyperpartisan dan tajuk berita emosi.

Bias dalam masyarakat

Satu lagi sumber bias berasal dari masyarakat. Apabila orang menyambung secara langsung dengan rakan sebaya mereka, kecenderungan sosial yang membimbing pemilihan rakan mereka datang untuk mempengaruhi maklumat yang mereka lihat.

Malah, dalam penyelidikan kami, kami dapati bahawa mungkin tentukan keluk politik pengguna Twitter dengan hanya melihat keutamaan partisan rakan-rakan mereka. Analisis kami tentang struktur ini rangkaian komunikasi partisan mendapati rangkaian sosial amat berkesan dalam menyebarkan maklumat - tepat atau tidak - bila mereka berkait rapat dan terputus dari bahagian masyarakat lain.

Kecenderungan untuk menilai maklumat lebih baik jika datang dari dalam kalangan sosial mereka sendiri membuat "bilik gema"Yang masak untuk manipulasi, sama ada secara sedar atau tidak sengaja. Ini membantu menjelaskan mengapa perbualan dalam talian begitu banyak berubah "Kita berbanding mereka" konfrontasi.

Untuk mengkaji bagaimana struktur rangkaian sosial dalam talian menjadikan pengguna terdedah kepada maklumat disinformasi, kami membina Hoaxy, sebuah sistem yang menjejaki dan menggambarkan penyebaran kandungan daripada sumber kredibiliti rendah, dan bagaimana ia bersaing dengan kandungan menyemak fakta. Analisis kami terhadap data yang dikumpulkan oleh Hoaxy semasa pilihan raya presiden 2016 AS menunjukkan bahawa akaun Twitter yang berkongsi maklumat salah hampir hancur dari pembetulan yang dibuat oleh pemeriksa fakta.

Apabila kami menggerudi ke akaun penyebaran maklumat yang salah, kami mendapati kumpulan teras yang sangat padat mengaburkan satu sama lain hampir semata-mata - termasuk beberapa bot. Satu-satunya masa yang organisasi pemeriksa fakta pernah dipetik atau disebut oleh pengguna dalam kumpulan yang salah maklumat adalah ketika mempersoalkan kesahihan mereka atau menuntut kebalikan dari apa yang mereka tulis.

Bias dalam mesin

Kumpulan ketiga bias timbul secara langsung dari algoritma yang digunakan untuk menentukan apa yang dilihat oleh orang dalam talian. Kedua-dua platform media sosial dan enjin carian menggunakannya. Teknologi pemperibadian ini direka untuk memilih hanya kandungan yang paling menarik dan relevan bagi setiap pengguna individu. Tetapi dengan berbuat demikian, ia mungkin akan menguatkan lagi kecenderungan kognitif dan sosial pengguna, sehingga menjadikan mereka lebih rentan terhadap manipulasi.

Contohnya, terperinci alat pengiklanan yang dibina di banyak platform media sosial biarkan pengiklan disinformation mengeksploitasi bias pengesahan by menyusun mesej kepada orang yang sudah cenderung untuk mempercayai mereka.

Juga, jika pengguna sering mengklik pautan Facebook dari sumber berita tertentu, Facebook akan cenderung untuk menunjukkan orang itu lebih banyak kandungan laman web itu. Ini yang dipanggil "gelembung penapis"Kesan boleh mengasingkan orang dari perspektif yang berbeza, mengukuhkan bias pengesahan.

Penyelidikan kami sendiri menunjukkan bahawa platform media sosial mendedahkan pengguna kepada set sumber yang kurang pelbagai daripada melakukan laman media sosial seperti Wikipedia. Kerana ini berada di tahap keseluruhan platform, bukannya pengguna tunggal, kami panggil ini kecenderungan homogenitas.

Satu lagi bahan penting media sosial ialah maklumat yang sedang berjalan di platform, mengikut apa yang mendapat klik paling banyak. Kami panggil ini kecenderungan populariti, kerana kami telah mendapati bahawa algoritma yang direka untuk mempromosikan kandungan yang popular mungkin memberi kesan negatif terhadap kualiti keseluruhan maklumat pada platform. Ini juga menyumbang kepada kecenderungan kognitif yang sedia ada, mengukuhkan apa yang kelihatan popular tanpa mengira kualitinya.

Semua pengakuan algoritma ini boleh dimanipulasi oleh bot sosial, program komputer yang berinteraksi dengan manusia melalui akaun media sosial. Kebanyakan bot sosial, seperti Twitter Big Ben, tidak berbahaya. Walau bagaimanapun, sesetengah menyembunyikan sifat sebenar mereka dan digunakan untuk niat jahat, seperti meningkatkan maklumat disinformasi atau salah mewujudkan rupa pergerakan akar umbi, juga dikenali sebagai "astroturfing." Kami dapati bukti jenis manipulasi ini dalam jangka masa untuk pemilihan midterm AS 2010.

Untuk mengkaji strategi manipulasi ini, kami membangunkan alat untuk mengesan bot sosial yang dipanggil Botometer. Botometer menggunakan pembelajaran mesin untuk mengesan akaun bot, dengan memeriksa beribu-ribu ciri yang berbeza dari akaun Twitter, seperti masa jawatannya, berapa kali ia tweet, dan akaun yang diikuti dan dihidupkan. Ia tidak sempurna, tetapi ia telah mendedahkan bahawa sebanyak Peratus 15 akaun Twitter menunjukkan tanda menjadi bot.

Menggunakan Botometer bersempena dengan Hoaxy, kami menganalisis teras rangkaian maklumat semasa kempen presiden 2016 AS. Kami mendapati banyak bot yang mengeksploitasi kedua-dua pengiktirafan kognitif, pengesahan dan populariti mangsa dan kecenderungan algoritma Twitter.

Bot ini dapat membina gelembung penapis di sekitar pengguna terdedah, memberi mereka tuntutan palsu dan maklumat salah. Mula-mula, mereka dapat menarik perhatian pengguna manusia yang menyokong calon tertentu dengan mencatatkan bahawa hashteg calon atau dengan menyebut dan men-retweet orang itu. Kemudian bot dapat menguatkan tuntutan palsu yang melontar lawan dengan menanamkan artikel dari sumber kredibiliti rendah yang menyesuaikan kata kunci tertentu. Aktiviti ini juga menjadikan sorotan algoritma untuk pengguna lain cerita palsu yang sedang dikongsi secara meluas.

Memahami kelemahan yang kompleks

Walaupun kajian kami, dan lain-lain, menunjukkan bagaimana individu, institusi dan seluruh masyarakat dapat dimanipulasi di media sosial, ada banyak soalan dibiarkan menjawab. Sangat penting untuk mengetahui bagaimana perbezaan berat sebelah ini berinteraksi antara satu sama lain, yang berpotensi mewujudkan kelemahan yang lebih kompleks.

Alat seperti kami menawarkan pengguna internet lebih banyak maklumat mengenai maklumat disinformasi, dan oleh itu beberapa tahap perlindungan dari bahayanya. Penyelesaiannya akan tidak mungkin hanya teknologi, walaupun mungkin terdapat beberapa aspek teknikal kepada mereka. Tetapi mereka mesti mengambil kira aspek kognitif dan sosial daripada masalah ini.

Mengenai Pengarang

Giovanni Luca Ciampaglia, Penolong Saintis Penyelidikan, Institut Sains Rangkaian Universiti Indiana, Universiti Indiana dan Filippo Menczer, Profesor Sains Komputer dan Informatika; Pengarah Pusat Penyelidikan Rangkaian dan Sistem Kompleks, Universiti Indiana

Artikel ini pada asalnya diterbitkan pada Perbualan. Membaca artikel asal.

Buku-buku yang berkaitan

at

Terima kasih kerana melawat InnerSelf.com, mana ada 20,000 + rencana mengubah hidup yang mempromosikan "Sikap Baharu dan Kemungkinan Baharu." Semua artikel diterjemahkan ke dalam 30+ bahasa. Langgan kepada Majalah InnerSelf, diterbitkan setiap minggu, dan Inspirasi Harian Marie T Russell. lahirnya Magazine telah diterbitkan sejak tahun 1985.

Terima kasih kerana melawat InnerSelf.com, mana ada 20,000 + rencana mengubah hidup yang mempromosikan "Sikap Baharu dan Kemungkinan Baharu." Semua artikel diterjemahkan ke dalam 30+ bahasa. Langgan kepada Majalah InnerSelf, diterbitkan setiap minggu, dan Inspirasi Harian Marie T Russell. lahirnya Magazine telah diterbitkan sejak tahun 1985.